Copilot für Teams: Der Interpreter – Sprachbarrieren überwinden

Die „Interpreter“-Funktion in Copilot für Teams bietet eine Echtzeit-Sprach-zu-Sprach-Übersetzung während laufender Besprechungen. Eine KI-Stimme dolmetscht fremdsprachiges Audio direkt und überlagert es – ähnlich wie bei TV-Interviews. So können alle Teilnehmenden in ihrer bevorzugten Sprache sprechen und zuhören. Das reduziert Missverständnisse und fördert eine zielgerichtete, inklusive Zusammenarbeit.

![]() Mehrwert: Abbau Kommunikationshürden

Mehrwert: Abbau Kommunikationshürden ![]() UseCase: Globale Telefonie

UseCase: Globale Telefonie ![]() Lesedauer: 5 Minuten

Lesedauer: 5 Minuten ![]() Schwierigkeit: Anfänger

Schwierigkeit: Anfänger

Bewertung der Funktion

Wie schlägt sich die Funktion?

So geht’s

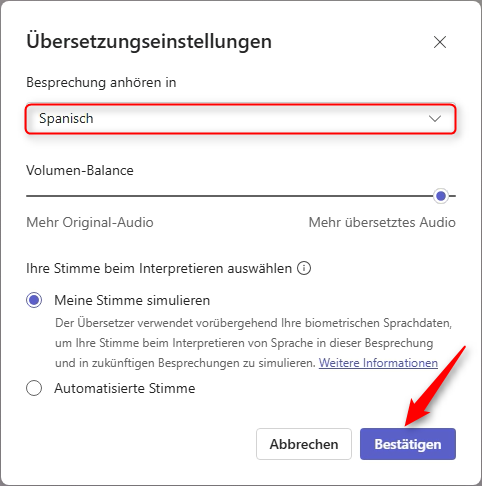

- Klicken Sie in der Teams-Steuerleiste auf das 3-Punkte-Menü Weitere.

- Wählen Sie Sprache und Sprechen.

- Klicken Sie auf Aktivieren Sie die Übersetzung.

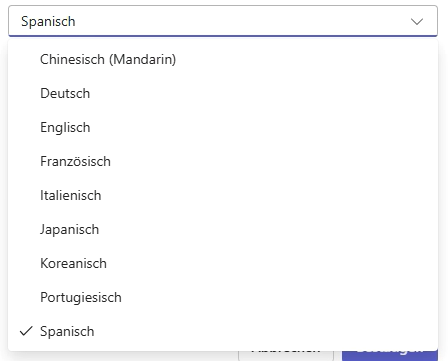

- Legen Sie die gewünschte Zielsprache fest.

- Passen Sie bei Bedarf die Stimme und die Balance zwischen Original- und Übersetzungsspur an.

- Speichern Sie Ihre Einstellungen mit einem Klick auf Bestätigen.

Technische Aspekte

- Die Funktion ist derzeit nicht in spontanen Besprechungen und Anrufen verfügbar.

- Aktuell werden nur neun Sprachen unterstützt.

Interpreter in Aktion

Sobald Sie die Übersetzungsfunktion für sich aktiviert haben, übernimmt Copilot für Teams die Dolmetscherrolle: Wenn eine Person in einer fremden Sprache spricht, wird deren Original-Audio automatisch in den Hintergrund gestellt. Stattdessen hören Sie eine KI-Stimme, die das Gesagte in Ihrer bevorzugten Sprache wiedergibt – ähnlich wie bei überlagerten TV-Interviews.

Die Übersetzung erfolgt satzweise und mit leichter Verzögerung: Erst wenn ein Satz oder Teilsatz beendet ist und der Sprecher eine kurze Pause macht, setzt die KI-Stimme ein. Parallel dazu wird Ihnen visuell angezeigt, wann die Übersetzung gerade eingesprochen wird. So können Sprecher bewusst Pausen einlegen, damit die KI „ausreden“ kann – für eine flüssigere und verständlichere Kommunikation.

Sprech- und Stimmqualität

Die KI-Stimme klingt überraschend natürlich. Besonders eindrucksvoll ist die Option, die Stimme des Sprechers zu imitieren – das schafft eine realistischere und persönlichere Kommunikationserfahrung.

Übersetzungsqualität

- Immer wieder Übersetzungslücken und -fehler, besonders bei leisem oder undeutlichem Sprechen

- Keine Überprüfungsmöglichkeit: Teilnehmende wissen oft nicht, ob die Übersetzung korrekt war.

- Eine kombinierte Darstellung aus Bild und Text wäre ideal für die Verständlichkeit. Die parallele Nutzung von Live-Untertiteln und der Interpreter-Funktion ist jedoch nicht empfehlenswert. Beide Systeme liefern unterschiedliche Inhalte und können sich gegenseitig stören.

Anforderungen an den Sprecher

- Langsames Sprechen mit Pausen verbessert die Verständlichkeit.

- Redepausen sind für die Verarbeitung durch KI essenziell – dies kann die Kommunikation jedoch erheblich verlangsamen.

- Der Sprecher sollte sich der Übersetzung bewusst sein, sein Redeverhalten daran anpassen und auf das Übersetzer-Symbol achten.

Einsatzszenarien

In internationalen Meetings wird häufig auf Englisch als Drittsprache ausgewichen. Problematisch wird es, wenn Teilnehmende kein oder nur gebrochenes Englisch sprechen – oder mit starkem Akzent. In solchen Fällen bietet die Echtzeit-Übersetzung eine wertvolle Alternative.

Weniger geeignet für interaktive Diskussionen: Spontane Zwischenrufe oder interaktive Gesprächsdynamiken sind für die KI schwer zu verarbeiten und können zu falschen oder fehlenden Übersetzungen führen.

Die Funktion eignet sich besonders gut für Präsentationen oder Meetings mit nur einem Sprecher, z. B. Webinare oder Präsentationen.

Fazit

Die Interpreter-Funktion bietet eine beeindruckend natürliche Sprachausgabe und kann Sprachbarrieren überwinden, ist aber nicht für jede Gesprächssituation ideal. Besonders bei interaktiven Meetings oder schnellem Redewechsel gerät sie an Grenzen. Mit etwas Übung und angepasstem Sprechverhalten lässt sich jedoch ihr Potenzial nutzen.